Midjourney正在測試名為Omni-Reference的創新功能,該工具將賦予用戶對生成圖像中視覺元素的顆粒級控制能力。

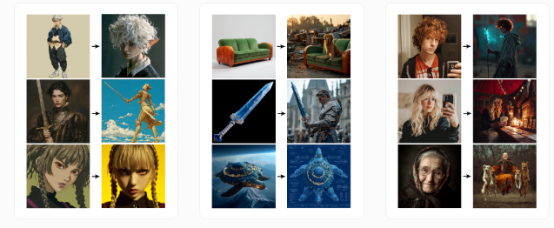

這套系統取代了V6版本的"角色參考"工具,并大幅擴展了可操控范圍——用戶現在可以精確指定從特定角色到獨立物件等任何元素。例如"在我的圖像中完全復現這個物體"這類指令已成為可能。

據Midjourney官方透露,Omni-Reference同時支持人類與非人類主體。該功能仍處于測試階段,未來版本將持續優化升級。

網頁端與Discord操作指南

在網頁界面中,用戶可將圖片拖拽至提示詞輸入框的"omni-reference"區域。通過滑塊可調節參考強度。Discord用戶需使用--oref參數+圖片URL調用功能,配合--ow參數控制權重值。

--ow(全能權重)參數決定參考圖像的融合程度,取值范圍0-1000(默認100)。進行風格轉換(如照片轉動漫)時,建議使用--ow 25等低值;如需保留面部特征或服裝細節等具體元素,推薦--ow 400等高值設置。

當配合--stylize(風格化)或--exp(表現力)等參數使用時,需相應調整全能權重以維持預期效果。官方特別提醒,若無特殊需求,不建議超過--ow 400的中等強度,過高數值可能導致圖像質量下降。

該功能可與風格參考、個性化設置及情緒板協同工作。要實現特定交互(如角色持劍),需在提示詞中明確描述"角色手持長劍 --oref sword.png"。當權重值較低時,補充文字描述有助于保留關鍵特征。

系統支持多圖同時參考(例如融合不同圖像的兩位角色),但需在提示詞中對應說明。目前該功能尚未適配V7版本的草稿模式。

精選文章: